오늘은 데이터 분석에 중요한 Feature Learning에 대해서 설명 드리겠습니다.

데이터 분석에서의 Feature selection과 feature extraction 차이, 특징, 설명을 드리겠습니다.

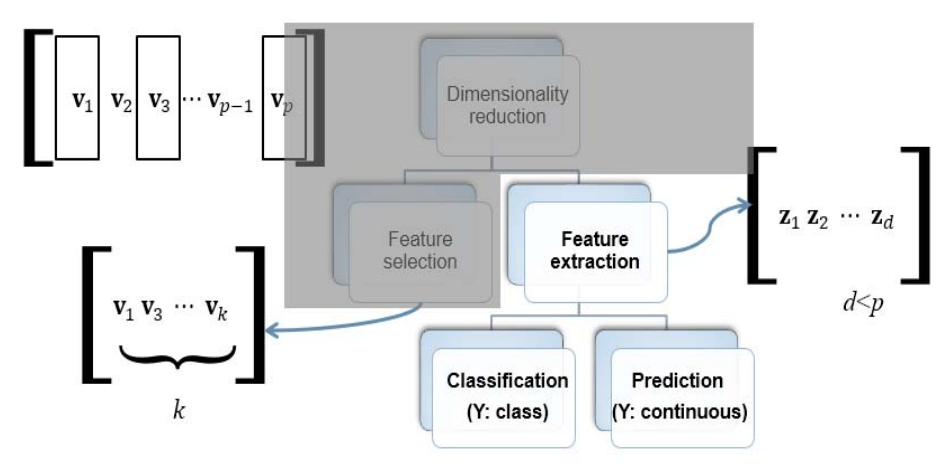

Feature Selection&Feature Extraction

Feature selection: 변수 선택 즉, 종속 변수를 설명하는 데 최적의 변수를 선택하는 것입니다.

Feature extraction: 엑기스를 뽑아낸다는 개념. 대표적인 것이 PCA인데, 변환을 통해 저차원으로 표현해내는 것입니다. 공분산을 잘 설명해주는 새로운 트랜스포메이션으로 표현하는 것입니다.

raw data에는 노이즈가 많고 변수들 간의 상관관계가 조금씩 존재하는데 이 때 Principal Component 사용합니다. 그렇게 해서 선택한 변수들로 다중회귀를 돌리면 정확도가 올라가는 경우도 볼 수 있습니다.

• Linear: PCA, LDA, Metric Multidimensional Scaling(MDS), …

• Non-Linear: Isomap, Locally-linear Embedding(LLE), Kernel PCA, Autoencoder

즉, fearture selection에 비해 feature extraction이 더 어려운 과정이라는 것을 아실 수 있습니다.

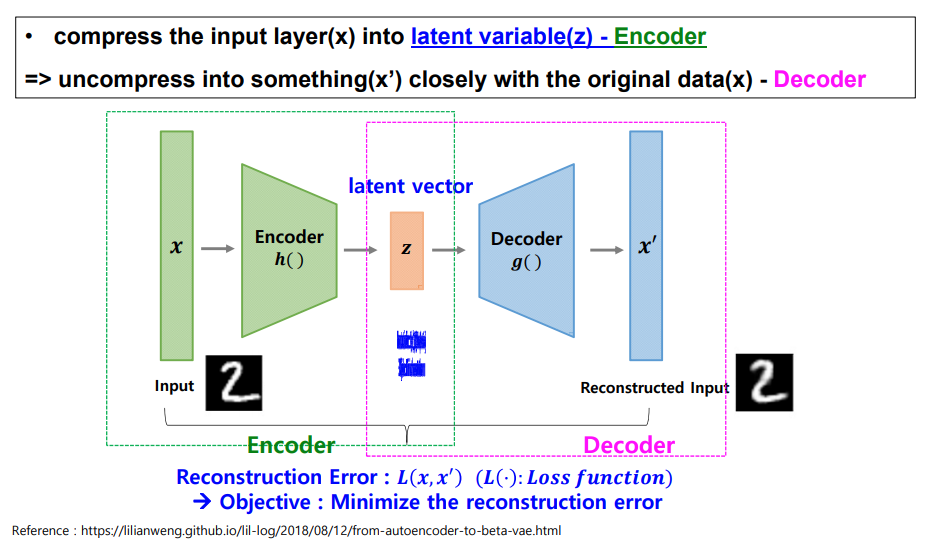

그 중에서도 AI 이미지 분류를 하는 데 주요하게 쓰이는 Auto-encoder에 대해 설명드리도록 하겠습니다.

아래에서 Input과 Reconstructed Input이 가장 유사한, 즉 reconstruction error를 최소화하는 latent vector를 사용하는 것입니다.

- compress the input layer(x) into latent variable(z) - Encoder

- → uncompress into something(x') closely with the original data(x) - Decoder

| 제 글이 조금이나마 도움이 되셨다면 좋겠습니다. 공감하기, 댓글, 구독하기는 블로그에 큰 힘이 됩니다. 🌻 열.건. (여러분의 건강을 응원합니다. 💛) |

댓글